Improved Representation Learning for Question Answer Matching

任务

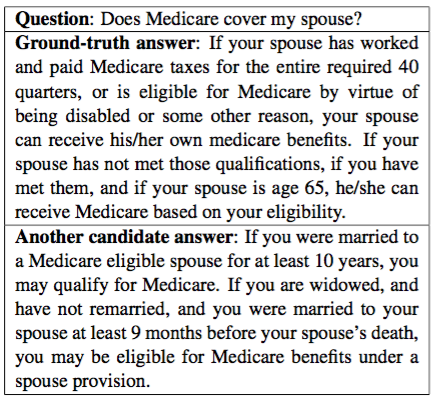

Q-Long A(passage-level question answer)

要解决的问题

- CNN: 局部关系(local interaction),LSTM:整体关系(long range information),how to combine?

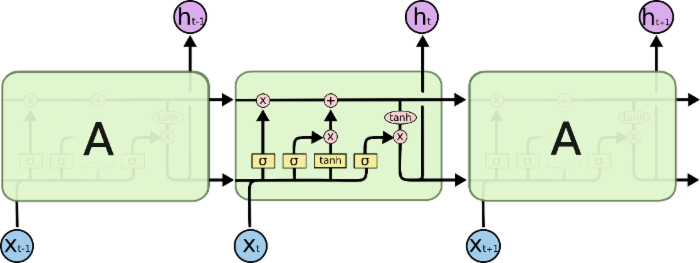

- An attention mechanism in LSTM

提出的方法

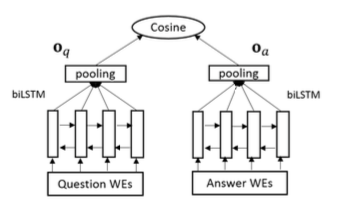

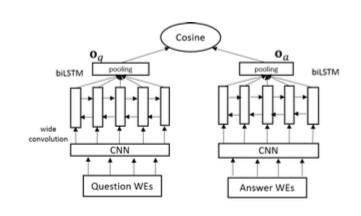

QA-LSTM:

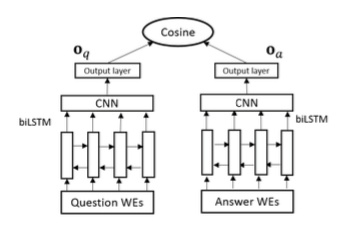

Convolutional-pooling LSTM:

Convolution-based LSTM:

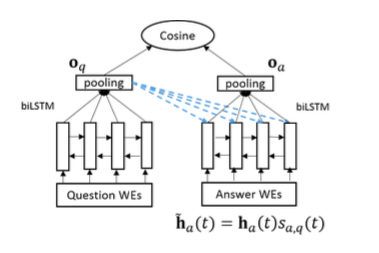

Attentive LSTM:

实验部分

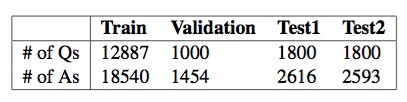

- 实验数据:InsuranceQA + TREC

- InsuranceQA -

TREC - 1162 training, 65 development and 68 test questions

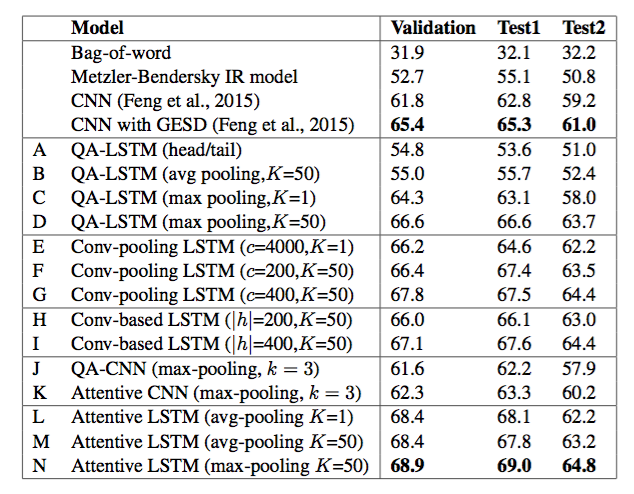

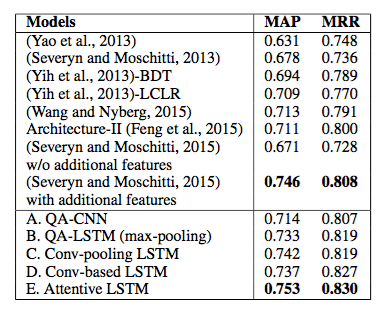

实验结果:

可借鉴的地方

- 1.任务和方法的契合度

- 2.实验的全面性

反馈与建议

- 微博:@伟康青年,@github

- 邮箱:wavejkd@pku.edu.cn